Метод Градиентного Спуска Алгоритм

Градиентный спуск —. Метод градиентного спуска с некоторой модификацией. Другой вариант метода спуска — метод наискорейшего (градиентного) спуска.

Насколько я понимаю, преимущество генетического алгоритма перед методом градиентного спуска заключается в том, что в отличии от гр. Спуска, ГА не упирается в локальный мин (макс). Я также знаю, что можно модифицировать алгоритм гр. Спуска таким образом, чтобы, например, через каждые N малых изменений переменных происходило одно сильное изменение, способное вытолкнуть алгоритм из лок минимума. Обладает ли ГА какими-нибудь преимуществами перед подобной модификацией метода гр. Заранее спасибо!!

Правила форума В этом разделе нельзя создавать новые темы. Если Вы хотите задать новый вопрос, то не дописывайте его в существующую тему, а создайте новую в корневом разделе 'Помогите решить/разобраться (М)'. Если Вы зададите новый вопрос в существующей теме, то в случае нарушения оформления или других правил форума Ваше сообщение и все ответы на него могут быть удалены без предупреждения. Не ищите на этом форуме халяву, правила запрещают участникам публиковать готовые решения стандартных учебных задач. Автор вопроса обязан привести свои попытки решения и указать конкретные затруднения. Обязательно просмотрите тему, иначе Ваша тема может быть удалена или перемещена в, а Вы так и не узнаете, почему. Доброе время суток!

- Sp-алгоритм метода решений. Градиентный метод. 3.1 Метод градиентного спуска.

- Градиентный спуск позволяет вам найти. Особенности схождения алгоритма.

Возможно, обращаюсь не по адресу, но как мне сказали сабжевый метод используется в вычислительной математике, я уже пару учебников проштудировал, но мало что понял. Собственно, вопрос: Пишу задание по летней практике, сам программист.

Выдали тему 'Сравнение методов поиска' и мне подтему 'Градиентный спуск'. После прочтения доступной литературы я был удивлен многообразием различных применений данного метода и теперь теряюсь в догадках, что же именно мне в программе реализовать. Используется и для определения координат точки, и для решения систем уравнений, в общем я в панике. Просьба к знающим людям, вкратце объясните доступно в чем заключается данный метод (а то от общих рассуждений голова уже пухнет) и, если таковые имеются, алгоритмы, на псевдокоде хотя бы или примеры. Спасибо заранее. Да ничего тут нет экстраординарного.

Этот метод может использоваться в задачах, в которых требуется максимизировать (или минимизировать) некоторую функцию, при условии что аргументы меняются непрерывно и функция дифференцируемая. При этом градиент показывает направление, в котором функция возрастает быстрее всего. Таким образом, если нужно максимизировать, то движемся в направлении градиента, если минимизировать - то в противоположном. Разумеется, есть ряд тонких моментов, которые приходится обходить или учитывать.

Метод Наискорейшего Градиентного Спуска Пример

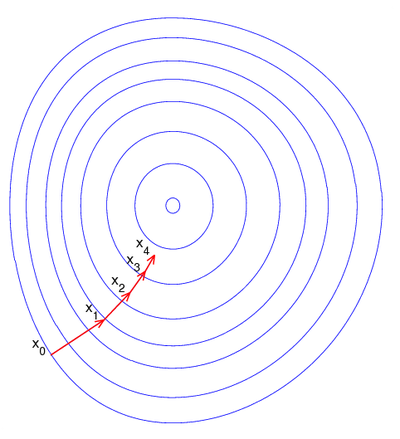

Идея метода довольно банальна и основана на том известном соображении, что функция быстрее всего убывает в направлении антиградиента (т.е. Противоположном градиенту). Почему этот метод часто и называют 'методом наискорейшего спуска'. Непосредственная цель метода - научиться находить минимум функции функции нескольких переменных. Берём некоторую точку в качестве начального приближения. И рассматриваем вспомогательную функцию одного переменного (здесь - это именно градиент, т.е. С ростом именно против него и сдвигаемся).

И подбираем так, чтобы эта самая приняла минимальное значение, после чего берём. А потом зацикливаем: на каждом шаге - точка минимума. Метод хорош своей надёжностью: на каждом шагу мы хоть чуть-чуть, да опускаемся, и при довольно широких условиях достижение минимума в пределе гарантировано.

А плох своей трудоёмкостью. Мало того, что сходится со скоростью лишь геометрической прогрессии (тут уж ничего не поделаешь - если с этим бороться, то потеряется универсальность). Но и даже поиск одномерного экстремума - тоже, в общем, морока. Поэтому обычно метод модифицируют, добиваясь на каждом шаге не точной, а хоть какой-нибудь минимизации (общая скорость сходимости от этого не шибко страдает). Ну и отдельная песня - овражистые функции, там этот метод практически отказывает; но там откажут и вообще любые (неспециализированные) методы. Спасибо всем ответившим, хочу уточнить последний раз.

(задание узнал, оно стандартно - найти минимум и максимум функции) Функция n переменных. Берем любую точку X0 с n координатами и вычисляем в ней значение функции. Находим частные производные функции (градиент в общем виде) 3. Подставляем в градиент значения X0.

Вычисляем новые координаты точки (разность между начальным значением и значением соотв. Координаты в векторе градиента) 5. Вычисляем значение функции в полученной точке. Сравниваем предыдущее и полученное значение, учитывая погрешность. Если разница меньше погрешности, останавливаемся. Если нет, то переходим к п. Если все верно, единственная проблема - запрограммировать нахождение производных.

Вычисляем новые координаты точки (разность между начальным значением и значением соотв. Координаты в векторе градиента) Нет, не так. Следующая точка находится как экстремум функции на прямой, проходящей через предыдущую точку и параллельной градиенту. Для этого пишется отдельная подпрограмма одномерной оптимизации. Впрочем, вам про это уже сказали выше. Там свои методы, можете ознакомиться в любом учебнике или в Википедии.quote='Alcoholfrei 'Сравниваем предыдущее и полученное значение, учитывая погрешность./quote Проверять недостаточно для хорошего результата алгоритма. Дело в том, что если у вас на некотором шаге перемещение было малым, на следующем оно может быть снова очень и очень большим.

ИМХО лучше делать, как я писал выше. А Вы попробуйте выписать практически универсальное условие, а потом ехидничайте Нам на парах давали что-то в духе. quote='Alcoholfrei 'Сравниваем предыдущее и полученное значение, учитывая погрешность. Проверять недостаточно для хорошего результата алгоритма. Дело в том, что если у вас на некотором шаге перемещение было малым, на следующем оно может быть снова очень и очень большим.

ИМХО лучше делать, как я писал выше./quote Так Ваш вышний рецепт как раз именно от этой-то проблемы и не спасает ( не говоря уж о том, что и выглядит странно - совсем разного типа величины почему-то сравниваются с одной и той же; впрочем, это, видимо, из-за 'что-то в духе'). Фактически достаточно отслеживать только, но - обязательно беря максимум по некоторой группе последних приближений. Например, по последним, где - размерность задачи (после каждых шагов условия сходимости более-менее повторяются).

Но и это ещё не всё. Метод градиентного сходится спуска (усреднённо) со скоростью геометрической прогрессии, т.е. Усреднённые разности соседних приближений убывают примерно как. Беда в том, что запросто может оказаться очень близкой к единице (величина оценивается через отношение минимального и максимального собственных чисел матрицы вторых производных в окрестности экстремума). Поэтому сравнивать надо не просто с, а с, т.е. С некоторым запасом.

Метод Градиентного Спуска Программа

Причём на практике величина тоже неизвестна, и её нужно оценивать по мере вычислений через усреднённые отношения усреднённых же приращений.